Машины научились узнавать наши эмоции

Уже можно волноваться?

Как утверждают ученые, машины уже научились определять эмоции человека: гнев, страх, отвращение, грусть. «Детектор эмоций» вырос из небольшого исследовательского проекта в индустрию стоимостью в $20 млрд. На чем основаны технологии и что же дальше?

LIGA.net приводит перевод статьи Оскара Шварца из The Guardian о том, как на ближайшее будущее человечества повлияет новые умения алгоритмов.

Начиналось с безопасности

Сможет ли компьютерная программа определять потенциальных террористов по выражению их лиц и поведению? Эту гипотезу начали проверять в 2003 году с подачи Администрации по Транспортной Безопасности США (TSA). Именно тогда была запущена программа наблюдения, которая получила название «Проверка пассажиров с помощью программ наблюдения» (Screening of Passengers by Observation Techniques) или SPOT.

Во время разработки программы специалисты консультировались с Полом Экманом, почетным профессором психологии Университета Калифорнии, Сан-Франциско. Несколькими десятилетиями ранее Экман разработал методику, которая позволяет идентифицировать мгновенные мимические образы и соотносить их с определенными эмоциями. Этот метод использовали для обучения полисменов.

От исследования к стартапу

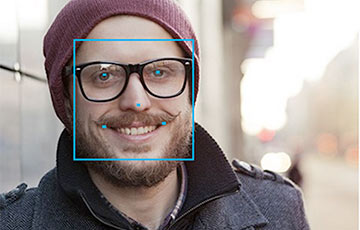

Технология определения эмоций требует двух техник: машинного зрения, чтобы точно идентифицировать мимику лица, а также алгоритмов машинного обучения для анализа и интерпретации смыслов выражений лиц.

Как правило, для второго шага необходимо «обучение с учителем», в процессе которого алгоритм тренируется определять эмоции, которые он «видел» ранее. Основная идея в том, что если вы покажете алгоритму тысячи фотографий с счастливыми лицами и меткой «счастливый», то когда машина увидит новое счастливое лицо, она даст ему именно эту метку.

Рана Эль-Калиуби, аспирант Кембриджского университета, была одним из первых ученых, кто стал исследовать эту сферу. В 2001 году перед получением докторской степени в компьютерных науках она предположила, что если бы она смогла научить компьютер определять ее эмоциональные состояния и реагировать на них, то время, проведенное вдали от ее семьи и друзей, было бы менее одиноким.

Во время работы над диссертацией Калиуби работала над этой проблемой, в итоге создав устройство, которое помогало детям с синдромом Аспергера читать мимику других людей и отвечать на нее. Исследователь назвала устройство «emotional hearing aid» («эмоциональный аппарат»). [Прим. пер. — по аналогии со слуховым аппаратом].

В 2006 году Калоуби присоединилась к «Affective Computing lab» в Массачусетском технологическом институте, где совместно с директором лаборатории Розалиндой Пикард продолжила совершенствовать технологию. В 2009 года она стала сооснователем стартапа Affectiva, который первым на рынке занялся разработкой искусственного эмоционального интеллекта.

Индустрия на $20 млрд

Первым делом Affectiva продала свою технологию идентификации эмоций как продукт для рыночных исследований, предполагающий анализ эмоциональных реакций на рекламу и продукты в режиме реального времени. Они анализировали клиентов таких компаний как Mars, Kellogg’s and CBS. Пикард покинула Affectiva в 2013 году и занялась различными стартапами по биометрике. Но бизнес продолжил расти, как и индустрия вокруг него.

Amazon, Microsoft and IBM объявили «эмоциональный анализ» одной из составляющих их собственных систем распознавания лиц. А многие компании поменьше, к примеру, Kairos and Eyeris, предложили сервисы, которые по функционалу почти полностью повторяют Affectiva.

Кроме исследований рынка технология определения эмоций сейчас активно используется, чтобы фиксировать падение внимательности водителей, анализировать пользовательский опыт для видеоигр, а также помогать медикам в оценке благополучия пациентов.

Калиуби, которая из небольшого исследовательского проекта по сути создала индустрию на $20 млрд, уверена: эта сфера будет расти и дальше. Она предполагает, что в недалеком будущем, когда технология будет использоваться повсеместно, устройства будут способны «понимать человека на интуитивном уровне».

База из 7,5 млн лиц из 87 стран

Прогресс в обучении машин определению эмоций зависит во многом от доступа к высококачественным данным.

По информации на сайте Affectiva, у них в наличии самая большая в мире база данных по эмоциям. 7,5 миллионов лиц из 87 стран — большинство из них собрано с согласия респондентов во время просмотра ТВ или во время вождения транспортного средства.

Все видео были рассортированы по 35 меткам в каирском офисе Affectiva. Выражения лиц были разобраны на составляющие: если специалисты видели нахмуренные брови, сжатые губы и глаза навыкате хотя бы долю секунды, эмоция сразу получала метку «гнев».

Отмеченные эмоции затем использовались для обучения алгоритма Affectiva, который учился интерпретировать человеческую мимику.

Методика присвоения меток, которые основаны на конкретных мимических особенностях, получила название «Система кодировки лицевых движений» или Emfacs, которую Пол Экман и Уоллес Фризен разработали в 1980-х.

Для проверки этой гипотезы ученые показывали экспертной группе фотографии людей из различных народностей и попросили идентифицировать эмоции на фото. Было обнаружено, что несмотря на культурные различия, люди выражают эмоции одинаковыми мимическими движениями. Лицо с опущенными бровями, сжатыми губами и глазами навыкате означает «гнев» как для банкира из США, так и для охотника из Папуа Новой Гвинеи.

Во второй половине XX века эта теория — которая уже называлась классической теорией эмоций — стала истоком науки об эмоциях. Экман усовершенствовал и запатентовал метод распознавания эмоций и стал продавать его как обучающую программу для ЦРУ, ФБР, Управления таможенной и пограничной охраны и Транспортной полиции. Идея, что настоящие эмоции человека можно прочитать на лице, стала основной популярного телесериала «Lie to Me» (на наших просторах «Теория лжи» или «Обмани меня» - Ред.).

Альтернативные взгляды

За последние годы классическая теория эмоций много раз подвергалась критике. Один из главных критиков - Лиза Фельдман Барретт, профессор психологии из Университета Нортистерн.

Барретт впервые узнала о классической теории в аспирантуре. Ей требовался метод точной классификации эмоций, и она наткнулась на метод Экмана. После анализа литературы она стала подозревать, что у методологии исследования были серьезные недостатки.

Барретт посчитала, что Экман непреднамеренно давал фокус-группе подсказки: под каждой эмоцией были варианты ответов, из которых и нужно было выбирать.

Вместе с группой коллег она проверила гипотезу Экмана без вариантов ответа, позволяя фокус-группе свободно описывать эмоции на фото. Корреляция между движениями мимики и конкретными эмоциями резко снизилась.

После получения результатов Барретт начала развивать собственную теорию эмоций, которая стала основой ее книги «Из чего созданы эмоции: тайная жизнь мозга» («How Emotions Are Made: the Secret Life of the Brain»). Она утверждает, что универсальных эмоций не существует. Но при этом каждая эмоция состоит из базовых составляющих.

«Они возникают как комбинация физических реакций вашего тела, которые гибкий мозг направляет сам себе, в зависимости от окружения, в котором он находится, уровня культуры и специфики воспитания, — пишет Барретт. — Эмоции — реальны. Но не на физическом уровне как, к примеру, нейроны в мозге. Они реальны как деньги — их нельзя назвать иллюзией, но это продукт соглашения между людьми».

Барретт объясняет, что нет смысла создавать общую карту мимических действий, ведь эмоции зависят от культуры и контекста. Когда один человек хмурится, будучи злым, то другой может в этот момент вежливо улыбаться, планируя пакость за спиной соперника. Из-за этого оценка эмоций лучше всего работает как динамическая практика, которая включает когнитивный процесс, межличностные взаимодействия и культурные особенности.

«Звучит сложно — и это на самом деле так, — утверждает исследовательница. — Эмоции — это комплексный процесс».

Больше, больше данных

Рана Эль-Калиуби согласна, что эмоции — это сложно. Именно поэтому команда Affectiva постоянно старается пополнить базу данных и улучшить систему их обработки. Она уверена, что это поможет сделать результаты системы более точными.

Исследователи планируют использовать для обучения алгоритмов не только видео, но также голос, походку и микромимику лица, которая не контролируется человеком. Калиуби уверена, что дифференциация данных позволит определять эмоции более качественно. И некоторые исследования утверждают, что машины уже опережают человека в этом.

Но Баррет также утверждает, что результат зависит не только от информации, но и он меток, которые ей присваиваются. Процесс захвата эмоций, которые используют компании для тренировки алгоритмов, может определять только «эмоциональные стереотипы».

Именно поэтому Affectiva собирает информацию из 87 стран. И исходя из полученных данных, в каждой стране есть особенные нюансы выражения эмоций. Бразильцы, к примеру, широко улыбаются, чтобы показать счастье, а в Японии улыбка в большинстве случаев показывает лишь вежливость.

Affectiva отмечает подобные культурные нюансы и добавляет дополнительный слой анализа в систему, который Калиуби называет «этнические критерии» или закодированное отображение, как эмоции выражаются в разных этнических культурах.

29.01.2025

Украинский дрон сбросил открытку, и оккупант из подразделения «Шторм V» решил сдаться в плен

29.01.2025

Украинский дрон сбросил открытку, и оккупант из подразделения «Шторм V» решил сдаться в плен

29.01.2025

Ватикан: Искусственный интеллект — это источник огромных возможностей, но также и глубоких рисков

29.01.2025

Ватикан: Искусственный интеллект — это источник огромных возможностей, но также и глубоких рисков

Новости и события в Беларуси и мире.

Пресс-центр [email protected]